L’Albanie Confie un Ministère à une IA pour Réformer

Introduction

Dans un monde où la corruption demeure un problème systémique, l’Albanie expérimente une approche révolutionnaire : l’introduction d’un ministre virtuel pour gérer les marchés publics. La nomination de Diella, une intelligence artificielle, marque une première mondiale et pose la question cruciale : peut-on réellement gouverner de manière éthique et efficace grâce à la technologie ?

Ce concept audacieux ne manque pas de susciter à la fois de l’enthousiasme et des doutes. Dans cet article, nous explorerons les particularités de cette initiative, son impact potentiel tout en mettant en lumière les défis et opportunités qu’elle soulève.

Diella : une IA à la barre des marchés publics

La nomination de Diella, un avatar féminin généré par ordinateur, vise à assainir les pratiques des marchés publics en Albanie. Développée pour superviser les appels d’offres, elle garantit des décisions apolitiques et impartiales grâce à des algorithmes avancés.

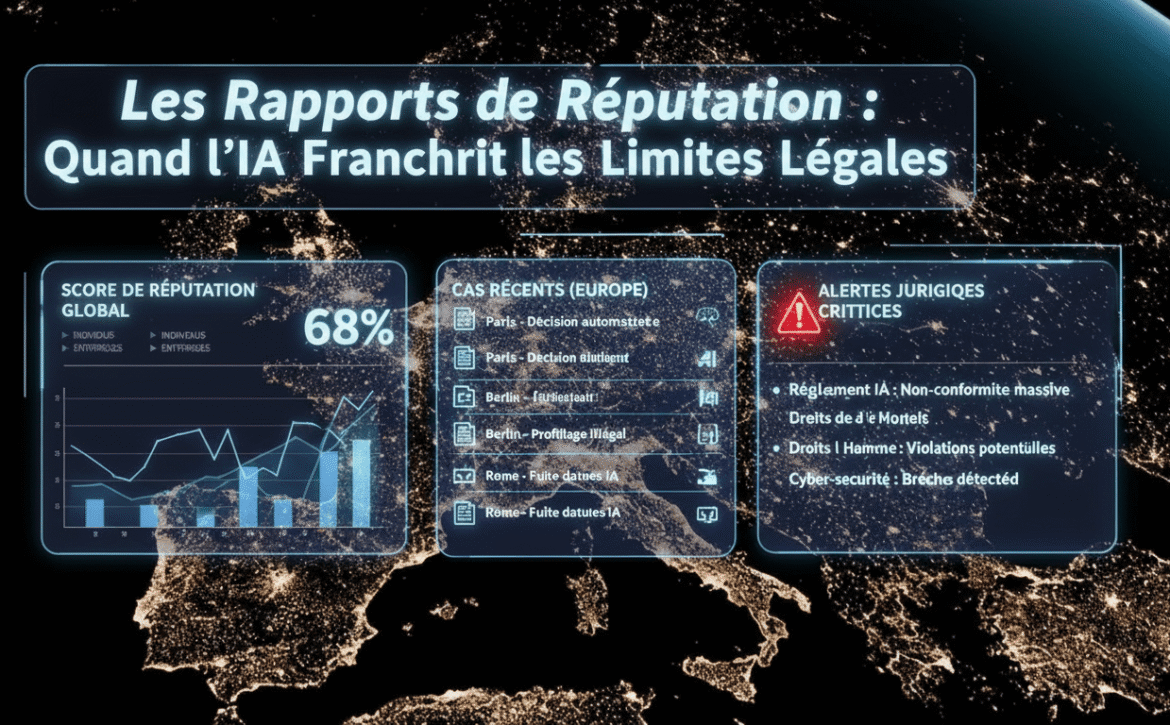

En se mettant à l’abri des influences et tentations humaines, Diella symbolise un espoir pour restaurer la confiance dans la transparence administrative. Cependant, la neutralité promise par les algorithmes est-elle réellement atteignable ? Des experts comme la CNIL alertent sur les biais programmatiques souvent présents dans les algorithmes.

Des débuts modestes mais prometteurs

Avant de devenir ministre, Diella a débuté comme un assistant numérique destiné à simplifier les procédures administratives, telles que le remplissage de formulaires. Ces essais ont permis de poser les bases de sa montée en puissance.

Maintenant propulsée au cœur des processus décisionnels, des questions émergent : quelles seront ses limites juridiques et pratiques ? Pourra-t-elle remplacer certains rôles gouvernementaux humains, ou servira-t-elle principalement de support virtuel évolutif ?

La lutte contre la corruption : les promesses d’une machine

Selon le gouvernement albanais, Diella ne peut être influencer par des pots-de-vin ou des pressions politiques. Une machine incorruptible est, en théorie, un atout majeur pour une gestion des fonds publics totalement transparente. Toutefois, comme discuté dans cet article de The Hacker News, l’intégrité des systèmes d’IA dépend aussi de leurs développeurs et des données utilisées.

En introduisant une IA dans un rôle aussi critique, Tirana met ses politiques à l’épreuve d’une analyse publique mondiale approfondie.

Critiques et scepticisme sur le rôle de l’intelligence artificielle

Malgré l’élan d’innovation, l’idée divise. Certains analystes jugent cette initiative prématurée dans un pays encore fortement marqué par des institutions fragiles. Par ailleurs, des critiques internationales ont souligné le problème d’une probable “boîte noire” où les décisions algorithmiques échappent à toute vérifiabilité humaine.

“L’objectivité algébrique reste un concept subjectif dans les codes”, note un expert technologue du MIT. En effet, l’efficacité et l’éthique de Diella dépendront largement de la supervision humaine ainsi que d’une réglementation clairement établie.

Des implications pour d’autres nations

L’Albanie ouvre potentiellement la voie à un avenir où les IA occuperaient des positions de pouvoir partout dans le monde. Pour des marchés publics complexes ou assurés au-delà des frontières, ce genre de ministre numérique pourrait réduire les coûts et accélérer les processus.

Des initiatives semblables pourraient-elles s’étendre à d’autres domaines ? Systèmes judiciaires, santé, ou même gestion climatique ? Plusieurs applications restent envisageables, encore faut-il s’assurer que la confiance publique soit solidement établie.

Découvrez ici comment une IA peut optimiser une gouvernance transparente tout en respectant la confidentialité des données.

Conclusion

L’Albanie lance un signal fort avec la nomination de Diella comme ministre des marchés publics. Ce pas audacieux dans un monde dominé par des luttes politiques montre que la technologie peut devenir un allié hors pair dans la régulation et la prise de décision publique.

Chez Lynx Intel, spécialisée en solutions innovantes et éthiques pour la gestion des risques, nous accompagnons nos clients à mieux comprendre et intégrer l’intelligence artificielle dans leur stratégie. Que ce soit pour des audits ou la gestion de données sensibles, explorez davantage dans notre guide sur comment maximiser sécurité et confidentialité numériques.